À la pointe de la robotique, les équipes du Joint robotics laboratory (JRL), au Japon, ont récemment travaillé sur Friends, un robot humanoïde d’aide à la personne. Aussi efficace en autonomie que piloté par un opérateur, il est capable de passer d’un état à l’autre en moins de deux secondes. Retour sur cette prouesse avec Guillaume Caron, directeur-adjoint du JRL.

Quelles sont les particularités des robots humanoïdes ?

Guillaume Caron. Nous développons des robots humanoïdes pour leur polyvalence. Ce sont des appareils généralistes qui, un peu à l’image de l’homme, sont moyens partout. Au niveau de leur conception, ils disposent d’énormément de degrés de liberté, c’est-à-dire d’articulations. La bipédie implique que ces robots soient capables de maintenir leur équilibre en permanence, ce qui est bien plus complexe qu’avec un robot sur roues ou un bras articulé.

Les robots humanoïdes sont particulièrement utiles dans des environnements pensés par des humains, pour des humains, car leur forme est adaptée à ces milieux. Depuis l’année dernière, on peut retrouver le robot Digit, conçu par la société américaine Agility Robotics, sur des chaînes de logistiques. Ces appareils ne sont donc plus de simples démonstrateurs ni des outils de communication, ils sont engagés sur le chemin des applications du monde réel.

Quels genres de défis les robots humanoïdes doivent-ils surmonter ?

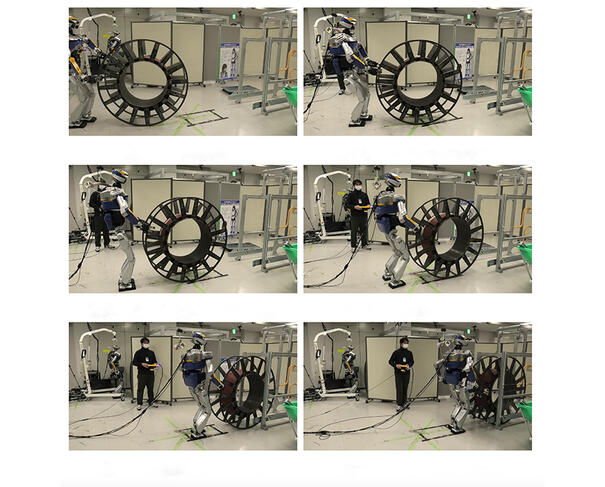

G. C. La locomanipulation est particulièrement compliquée : le robot doit marcher tout en manipulant des objets. Dans l’immense majorité des cas, il doit séparer ces tâches et les effectuer chacune leur tour. C’est tout un défi d’y arriver sans que le robot perde l’équilibre, car il est confronté à des résistances et des frottements qui sont difficiles à quantifier. Il doit tout de même savoir s’adapter à ces perturbations. Nous avons organisé une démonstration en décembre dernier, au salon international de robotique Irex, à Tokyo, de l’assistance au transfert d’un patient par le robot Friends du lit à un fauteuil roulant. La machine parvient à se déplacer tout en plaçant correctement le patient. Cette réussite s’inscrit dans la lignée de nos humanoïdes HRP-2Kai et HRP-5P, qui sont capables de mouvoir avec précision des bobines industrielles de cent trente kilos !

Pouvez-vous nous en dire plus sur le robot Friends ?

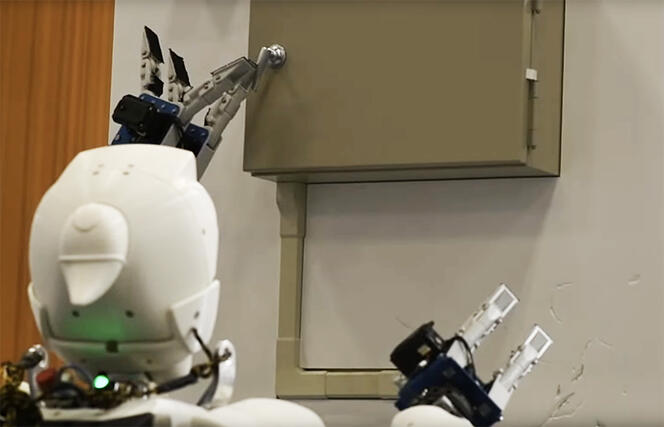

G. C. Ce robot humanoïde a été conçu par le groupe japonais Kawasaki Heavy Industries, célèbre en Occident pour ses motos. Il mesure moins d’un mètre soixante-dix et pèse une cinquantaine de kilos. Nous lui avons ajouté les mains, un système de caméras dans la tête et, dans son dos, nous avons installé des batteries et deux ordinateurs. Le premier est focalisé sur l’équilibre du robot pour s’assurer qu’il ne tombe pas. Le second est dédié à la vision, ce qui demande davantage de puissance de calcul, mais s’accommode aussi d’un temps de latence un peu plus élevé.

Kawasaki nous a contactés pour travailler sur Friends grâce à notre expérience avec Airbus. Nous les avions en effet aidés à faire entrer des robots humanoïdes dans des chaînes de production d’avions, qui sont des espaces difficiles à automatiser à cause de leurs énormes volumes. Kawasaki s’intéresse à ce genre d’applications industrielles, mais également au secteur de la santé. Dans le contexte d’une population japonaise vieillissante et de projections de main-d’œuvre en berne, l’entreprise réfléchit à l’automatisation de certaines tâches réalisées par des aides-soignants.

Qu’est-ce qui rend Friends unique ?

G. C. Sa principale caractéristique est qu’il marche aussi bien en autonomie que guidé par un humain équipé d’un casque de réalité virtuelle (VR). Mieux encore, Friends peut basculer d’un contrôle à l’autre sans avoir besoin d’être redémarré, et en moins de deux secondes. C’est moins que le temps qu’il faut à un opérateur pour enfiler le casque VR et prendre les manettes. À notre connaissance, aucun autre robot ne le fait aussi vite et bien.

Cette fonction permet au robot de passer instantanément le relais à un humain lorsqu’il rencontre un problème qu’il ne peut pas résoudre tout seul, ou s’il s’est perdu. Friends est programmé pour apprendre des séries de tâches répétitives, mais il peut toujours se retrouver face à des imprévus ou à des manœuvres trop fines, qu’il ne sait pas encore gérer sans aide extérieure. Cette bascule est rendue possible par la plateforme logicielle mc_rtc, que nous avons développée au JRL. Elle permet à la base de basculer un même contrôleur d’un robot à un autre, puis nous l’avons poussée pour qu’elle puisse passer de l’autonomie à l’humain et vice-versa.

Comment Friends gère-t-il ces deux fonctionnements différents ?

G. C. Le robot est équipé de deux types de caméras, adaptées à chaque mode de contrôle. La première aide Friends à détecter les objets à attraper, ainsi qu’à cartographier son environnement. Les images stéréo permettent, quant à elles, d’être diffusées dans un casque de VR, donnant l’impression à l’opérateur d’être à la place du robot. La gestuelle de l’engin reste également proche de celle des humains, pour que les solutions pensées par le téléopérateur s’accordent au maximum avec les mouvements dont Friends est capable, y compris pour des manipulations fines.

Friends a aussi été conçu pour paraître et agir de la manière la plus amicale possible. Avec son petit gabarit, il semble peu impressionnant par rapport à d’autres robots industriels. Cela rassure les personnes qui œuvrent à côté ou sont aidées par la machine. C’est très important pour son acceptabilité.

Quels avantages y a-t-il pour une équipe CNRS à travailler dans un International research laboratory implanté au Japon ?

G. C. Cette situation nous donne accès à des partenariats en or avec de grandes entreprises japonaises comme Kawasaki, mais aussi Kawada Robotics. Nous bénéficions également d’échanges de compétences avec nos collègues nippons de l’Institut national des sciences et technologies industrielles avancées (AIST). Ce sont des experts mondiaux en modélisation et en conception mécanique de robots humanoïdes, ainsi que de leur commande automatique. De notre côté, nous leur apportons notre expérience sur la partie logicielle, sur la perception des robots, en particulier pour saisir un objet ou se déplacer à un endroit précis, ainsi que sur le passage d’un contrôleur à un autre.

Quels sont vos projets pour la suite ?

G. C. Nous voulons pousser les liens entre autonomie et téléopération, notamment en les soudant plutôt que de passer complètement de l’un à l’autre. L’idée serait que le robot garde une forme de semi-autonomie lorsqu’il est manipulé à distance. En effet, la téléopération induit du délai dans la transmission de l’information, qu’il s’agisse des commandes de l’humain ou des images qu’il reçoit dans son casque de VR. Cette latence se traduit par une sorte de mal des transports qui peut nuire à l’accomplissement de la tâche. L’idée serait de permettre au système de détecter et d’anticiper les intentions de l’opérateur.

Nous venons aussi de lancer deux projets, financés par l’Agence nationale de la recherche française. Le premier sera coordonné par le Laboratoire d’analyse et d’architecture des systèmes et vise à des interactions plus dynamiques entre robots et humains. Actuellement, lorsque quelqu’un veut échanger un objet avec une machine, l’un des deux doit s’immobiliser pour que l’autre puisse terminer l’action. Nous aimerions obtenir des relations plus fluides, pour des contextes comme la logistique et l’usine du futur.

Le second projet, dont nous sommes cette fois porteurs au JRL, aspire à améliorer le déplacement des robots humanoïdes grâce à des méthodes bioinspirées. Nous serons pour cela épaulés par des spécialistes du biomimétisme de l’Institut des sciences du mouvement. Nous allons regarder du côté de fourmis qui parviennent à s’orienter dans le désert malgré une mémoire visuelle limitée. Sans plan ou cartographie en 3D, à l’aide d’un réseau de neurones de seulement quelques octets de mémoire, nous comptons apprendre aux robots des chemins de quelques dizaines de mètres. Ils fonctionneraient alors avec des systèmes bien plus simples et économes en énergie.♦